«Wir sollten versuchen, gute Vorfahr:innen zu werden»

Was haben Nuklearkriege, von Menschen verursachte Pandemien und Internetkabel mit den Erbauern der Kathedralen des Mittelalters zu tun? Zukunftsforscher Lord Martin Rees von der Universität Cambridge im Interview.

Interview: Sebastian Sele

Der Flügelschlag eines Schmetterlings kann ausreichen, um die Welt ins Wanken zu bringen. So besagt es die Chaostheorie. Tatsächlich ist es so, dass die richtige Folge an scheinbar kleinen Entscheidungen enorme Auswirkungen haben kann. Existenzielle Auswirkungen. Mit solchen existenziellen Risiken, die das Potenzial haben, uns als Spezies auszulöschen, beschäftigen sich die Forschenden am Centre of the Study of Existential Risk (CSER) an der Universität Cambridge.

Martin Rees ist einer der drei Gründer des CSER. Der ehemalige Professor für Kosmologie und Astrophysik in Cambridge bekam mit, wie sich die Erfinder der Atombombe gegen den Einsatz ihrer eigenen Erfindung stemmten. Und ihm wurde klar: Auf sie muss eine neue Generation folgen, die diesen Effort für die Ethik fortführt. Rees, 83, Mitglied des House of Lords, ehemaliger Präsident der Royal Society und einer der anerkanntesten Wissenschaftler der Welt, verschrieb und verschreibt sich dem Kampf für das Gute.

Mr. Rees, Sie begründeten und betreiben das Centre for the Study of Existential Risk. Warum?

Als Professor in Weltraumforschung, Astronomie und Physik erhielt ich zwei Perspektiven: Erstens ein Gefühl für den kosmischen Zeitrahmen. Wir Menschen sind nicht die Krönung des Kosmos – die Sonne ist noch nicht einmal in der Hälfte ihres Lebens, also sind wir womöglich nicht einmal auf halbem Weg in unserer Evolution von Komplexität und Bewusstsein. Zweitens die Erkenntnis, dass wir die erste Spezies sind, die die Macht hat, den ganzen Planeten zu verändern. Ich sorge mich um die Schattenseiten mächtiger Technologien. Und viele Wissenschaftler:innen teilen meine Sorge.

Wie sieht die Arbeit am CSER aus?

Wir befassen uns seit 2012 mit Extremrisiken. Von Künstlicher Intelligenz und Biotechnologie bis zu Klimawandel und Ernährungssicherheit. Forschende aus diversen Disziplinen von Biologie bis Philosophie kommen zusammen, um diese existenziellen Risiken besser zu verstehen und so die Welt zu einem besseren Ort zu machen.

Das CSER beschränkt sich also nicht nur auf die Forschung?

Nein, wir beraten auch Regierungen und internationale Organisationen. Als wir anfingen, hielten viele unsere Arbeit für alarmistisch. Wir wurden als Schwarzmaler:innen abgeschrieben. Aber seit Covid behauptet das niemand mehr – und dabei hatte SARS-CoV-2 eine Sterblichkeit von weniger als 1 Prozent. Stellen Sie sich ein Virus mit 70 Prozent Sterblichkeit vor.

Solche Weltuntergangsszenarien haben etwas von Science-Fiction. Wie können Sie garantieren, dass Sie nicht mit Scheinwissenschaft Panik schüren?

Wir sind an der Universität Cambridge, einer der führenden Universitäten der Welt, und arbeiten nach deren Standards. Wir können natürlich nicht alle Szenarien komplett durchdeklinieren, doch wer könnte besser darin sein, die Gefahren für die Menschheit zu erkennen, als wir? Universitäten sollten keine Elfenbeintürme sein, sondern die möglichen Auswirkungen ihrer Erkenntnisse angehen.

2003 schrieben Sie, die Chancen der Menschheit, das 21. Jahrhundert zu überleben, lägen bei

50 Prozent. Heute, ein Vierteljahrhundert später – wie stehen wir da?

(Lacht) Diese Zahl war nicht wörtlich gemeint. Mein Hauptpunkt war, dass wissenschaftlicher Fortschritt neue Gefahren mit sich bringt.

Welche?

Atomwaffen waren damals die offensichtliche Sorge. Ich war einer der Ersten, der die breite Masse auf die Risiken der Biotechnologie hinwies. Natürliche Pandemien haben es heute einfacher, weil wir global vernetzt sind – die Pest im Mittelalter kam nie nach Australien. Hinzu kommt die Erschaffung tödlicherer, ansteckenderer oder resistenterer Erreger durch sogenannte «Gain-of-Function»-Experimente in Laboren.

Sorgen Sie sich inzwischen mehr um Bio- als um Atomtechnologie?

Im Gegensatz zu Atomwaffen braucht es für Biowaffen keine riesigen, schwer zu verbergenden Anlagen. Die nötige Ausrüstung ist weltweit verbreitet, auch in Universitäten oder kleineren Labors. Schon ein einzelner böswilliger Akteur oder eine kleine Gruppe könnte absichtlich oder fahrlässig eine Katastrophe auslösen.

Wie lässt sich dieses Risiko minimieren?

Wissenschaftler:innen sollten die Gefahren ihrer Arbeit im Blick behalten – und gleichzeitig die Regierungen dazu bringen, sich dieser bewusst zu werden. Die Biotechnologie ist untererforscht. Und eine verbindliche Kontrollinstanz wie die IAEA für die Atomkraft gibt es nicht.

Welche weiteren Risiken bereiten Ihnen besonders grosse Sorge?

Eine wachsende Sorge ist unsere Abhängigkeit von globalen Netzwerken: Flugverkehrskontrolle, Stromnetz, Internet.

Können Sie konkrete Beispiele nennen?

99 Prozent des weltweiten Internetverkehrs laufen über Unterseekabel. Werden diese gekappt, wofür es keine Hightech braucht, bricht die globale Kommunikation zusammen. Ähnliches gilt für GPS, die Flugsicherung und generell weltweite Lieferketten.

Ein Nuklearkrieg wird von Forschenden regelmässig als existenzielles Risiko gehandelt. Der Atommüll kommt kaum zur Sprache. Wo steht dieser auf Ihrer Liste?

Er ist wie der Klimawandel eine langsam wirkende Bedrohung. Aber er wirft eine wichtige ethische Frage auf: Wie sehr kümmern wir uns um künftige Generationen? Die Planung für die Endlagerung erfordert ein Denken über Zehntausende oder gar eine Million Jahre. Es ist der einzige Bereich, in dem so langfristig gedacht wird.

Als Gesellschaft wird unser Fokus aber immer kurzfristiger.

Ja, das gilt nicht nur für den Atommüll, sondern auch für den Klimawandel: Die grössten Auswirkungen werden erst in 100 oder 200 Jahren spürbar sein. Doch es ist schwer zu vermitteln, dass das Problem schon heute wichtig ist. Wir sorgen uns lieber um die Menschen, die wir bereits kennen.

Das beeinflusst auch die Politik.

Genau, Regierungen nehmen existenzielle Risiken generell nicht ernst genug. Es ist unwahrscheinlich, dass diese eintreten – und noch unwahrscheinlicher ist, dass sie während der Amtszeit eintreten. Dennoch sollten wir uns auf sie vorbereiten. Denn viele dieser Risiken werden von Jahr zu Jahr wahrscheinlicher und ihre Folgen wären verheerend.

Wie lässt sich das überwinden?

Wir sollten versuchen, gute Vorfahr:innen zu werden. Wir sollten uns bewusst werden, was frühere Generationen für uns geleistet haben. Wir wissen heute, dass die Erde noch einige Milliarden Jahre bestehen wird. Die Kathedralenbauer des Mittelalters glaubten, die Welt würde in ein paar Hundert Jahren enden. Trotzdem errichteten sie Gebäude, die erst nach ihrem Tod fertiggestellt wurden. Heute fällt es uns schwerer, langfristig zu planen. In nur fünfzig Jahren können sich unsere Technologien und unser Leben komplett verändern.

Kommen wir zurück ins Hier und Jetzt: Kurzfristig sehen Sie im Atommüll also keine Bedrohung?

Kurzfristig wird Atommüll wohl keine globale Katastrophe auslösen. Die grösste Gefahr besteht in lokaler Strahlenbelastung. Doch schlecht gesicherte Anlagen könnten ein Ziel für Terroristen werden. Atommüll bleibt also ein dauerhaftes Risiko. Und es wird in den kommenden Jahrzehnten nicht abnehmen.

Aktuell diskutieren alle über Künstliche Intelligenz. Auf welcher Seite des Glaubenskriegs stehen Sie: Wird uns die Technologie retten oder zerstören?

Ich glaube, der Hype darum, dass KI bald übermenschlich wird und «die Kontrolle übernimmt», ist zu gross. Aber ich sorge mich um unsere Überabhängigkeit von fragilen, global vernetzten Systemen. Wenn diese ausfallen, sei es durch Panne oder Cyberangriff, kann die Weltwirtschaft und die soziale Ordnung innert Tagen ins Straucheln geraten. Besonders heikel daran ist, dass einige wenige, sehr mächtige Unternehmen diese Entwicklungen vorantreiben. Deshalb braucht es Regierungen, die diese regulieren und überwachen.

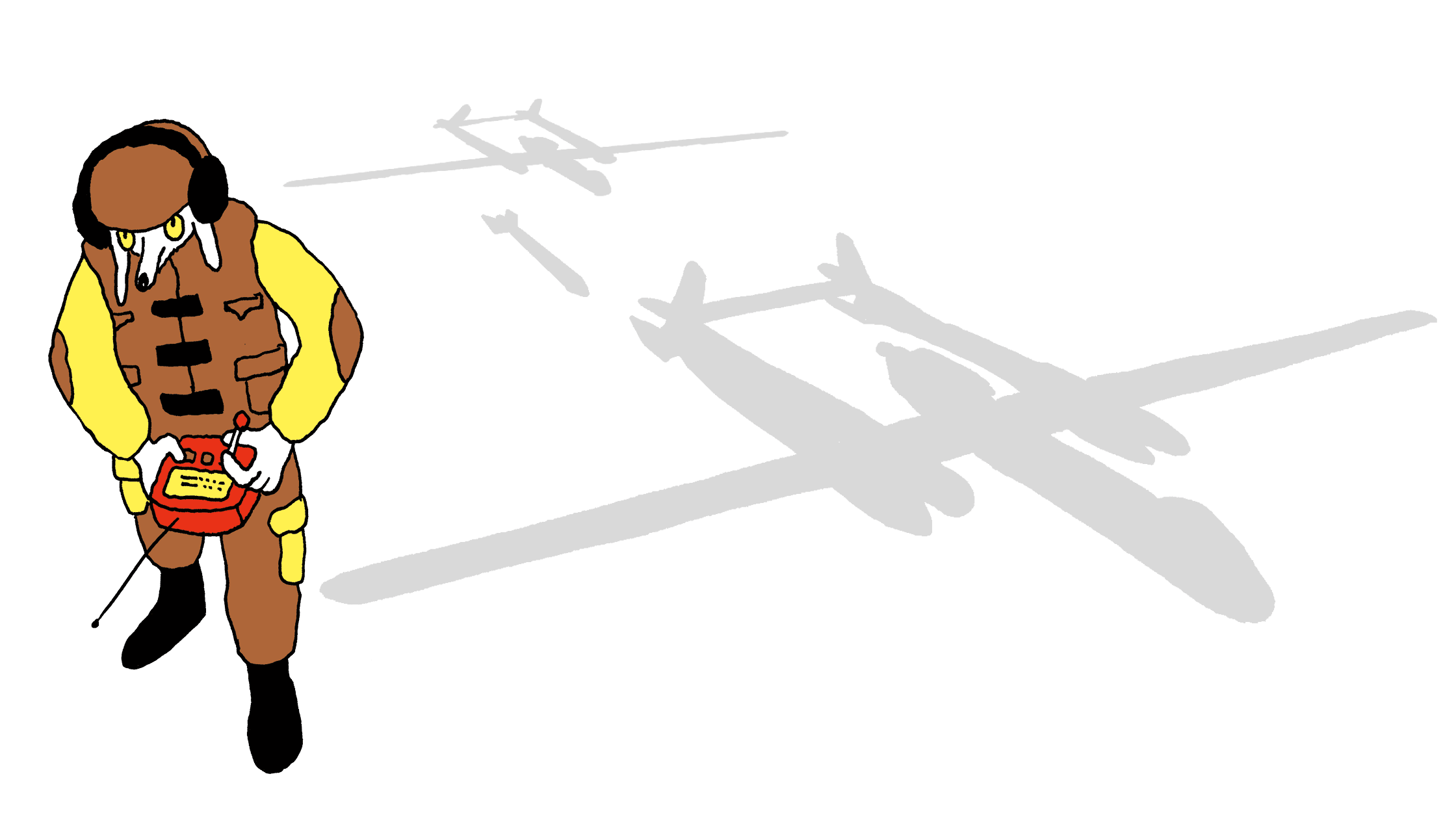

Kann Regulierung bei KI funktionieren? Nehmen wir zum Beispiel die Entwicklung autonomer Waffensysteme: Es mag 192 Länder geben, die eine Regulierung beschliessen – doch es braucht nur ein einziges Land, das ausschert.

Das ist tatsächlich eine grosse Herausforderung. Einen internationalen Konsens, wie er beim Klimawandel angestrebt wurde, sehe ich als beste Lösung. Weicht ein Staat davon ab, braucht es internationalen Druck und drohende Sanktionen. Viel mehr können wir kaum tun.

Unbestritten ist, dass KI unseren Alltag im kommenden Jahrzehnt grundlegend verändern wird. Wie sollten wir die Technologie nutzen?

Es gibt viele Vorteile: Eine KI kann 30’000 Röntgenbilder analysieren – weit mehr, als ein Arzt oder eine Ärztin in seinem oder ihrem ganzen Leben sehen würde – und Lungenkrebs genauer erkennen. In der Wettervorhersage kann KI jahrzehntelange Wolkenmuster auswerten und Stürme präziser vorhersagen als traditionelle Simulationen. Diese Vorteile sollten wir nutzen, gleichzeitig aber die Schattenseiten, wie etwa einen Zusammenbruch der Systeme, verhindern.

Sie sprechen es an: KI wird die Arbeitswelt verändern und den Arbeitsmarkt grundlegend umkrempeln.

Ja, KI wird Arbeitsplätze verdrängen. In Callcentern und Büros werden weniger Menschen benötigt werden. Das ist unvermeidlich. Statt zu versuchen, diesen Wandel aufzuhalten, sollten wir ihn sozialverträglich gestalten. Entscheidend ist, dass wir KI-Unternehmen besteuern und die Menschen, deren Jobs verschwinden, auffangen. Andernfalls drohen nicht nur wirtschaftliche Verwerfungen, sondern auch wachsende gesellschaftliche Spannungen.

Angesichts dieser Entwicklungen: Welchen Beruf sollten junge Leute heute ergreifen?

Berufe, die sich nicht leicht automatisieren lassen und einen klaren Sinn haben: Medizin, Unterricht oder Recht. Auch Berufe wie Sanitär:in oder Gärtner:in bleiben wichtig. Tätigkeiten mit direktem menschlichem Kontakt, etwa in der Betreuung älterer Menschen oder in der Sozialarbeit, werden kaum durch KI ersetzt. Und natürlich brauchen wir Menschen, die die KI selbst beaufsichtigen und hinterfragen.

Und von welchem Beruf würden Sie abraten?

Von Berufen, die auf Coding aufbauen.

Eine Fähigkeit, die vor zehn Jahren noch als Zukunft galt.

Ja.

Es geraten gerade viele Sicherheiten ins Wanken: Seit 2020 haben wir eine Pandemie erlebt, ein Krieg ist nach Europa gekommen, jetzt noch KI.

Viele hatten früher ein besseres Leben – wir waren in kleinen Gemeinschaften und kannten unseren Arzt, unsere Lehrerin und so weiter. Doch wir müssen akzeptieren, dass der Wandel real ist. Er erleichtert vieles, bedroht aber auch den Zusammenhalt unserer Gesellschaft. Besonders beunruhigt mich dabei, dass durch das Internet und die sozialen Medien heute jede:r Zugang zu globaler Kommunikation und Propaganda hat. Das polarisiert unsere Gesellschaften und gibt Populismus Auftrieb. Doch gleichzeitig zeigt die Geschichte: Solche technologischen Innovationsschübe flachen oft wieder ab.

Wie meinen Sie das?

Die Luftfahrt ist ein gutes Beispiel: Vom ersten Flug über den Atlantik bis zur Boeing 747 vergingen nur fünfzig Jahre – seither gab es wenig Fortschritt. Und die Concorde, das Überschallflugzeug, verschwand sogar wieder. Dieses Muster zeigt, dass nicht alles exponentiell weiterwächst.

Sie beschäftigen sich tagein, tagaus mit Katastrophenszenarien. Trotzdem lächeln sie und wirken locker. Wie schaffen Sie es, nicht paranoid zu werden und überall den Weltuntergang zu sehen?

Ich versuche, eine Balance zu halten. Viele der Bedrohungen, über die wir sprechen, können auch ausbleiben – und wir können einiges tun, um die Risiken zu verringern. Was uns nicht paranoid, aber deprimiert machen sollte, ist die wachsende Lücke zwischen der Welt, wie sie ist, und der Welt, wie sie sein könnte. Das, was wir im Sudan, in Gaza und so weiter sehen können.

Es gibt auch Menschen, die sagen, die Welt werde beständig besser.

Ja, Steven Pinker zum Beispiel hat ein Buch darüber geschrieben, dass vieles besser geworden ist: Lebenserwartung, Alphabetisierungsgrad, weniger Gewalt. Doch er unterschätzt die neuen Risiken, die uns bedrohen und oft übersehen werden.

Die Statistik gibt Pinker recht.

Ich habe selbst öffentlich mit ihm darüber diskutiert: Bis zu einem gewissen Grad hat er recht. Pinker glaubt jedoch, nicht nur die Welt werde besser, sondern auch unsere Ethik. Dem widerspreche ich deutlich. Ich sehe überhaupt keinen Fortschritt in der globalen Ethik.

Können Sie das ausführen?

Wenn wir noch einmal ins Mittelalter zurückblicken, zu den Kathedralenbauern, erkennen wir: Ihr Leben war hart und oft miserabel, aber die Lücke zwischen Realität und Möglichkeit war klein, weil es schlicht wenig Gestaltungsspielraum gab. Heute hingegen verfügen wir über die Technologie, um allen ein gutes Leben zu ermöglichen. Dass es dennoch so viele Kriege, Ungleichheiten und Blockaden gibt, liegt nicht an unseren Möglichkeiten, sondern an Politik und Wirtschaft. Das ist ein guter Grund, depressiv zu sein.

Sind Sie persönlich risikofreudig oder risikoscheu?

Ich würde mich als eher risikoscheu bezeichnen. Ich lebe ein bequemes, entspanntes Leben, ohne den Drang nach Nervenkitzel oder Extremsportarten wie Bergsteigen.

Unsere Hypothese: Damit sind Sie in guter Gesellschaft. Die Risikobereitschaft scheint generell zu sinken. Wir versichern alles, was sich versichern lässt, und selbst Freizeitrisiken sind streng kalkuliert. Teilen Sie diesen Eindruck?

Das stimmt schon. Es gibt zwar Menschen, die sehr gefährliche Dinge tun und darin Befriedigung finden – aber für ein erfülltes Leben braucht es das nicht. Im Gegenteil: Es ist etwas Gutes, dass man heute leben kann, ohne gezwungen zu sein, extreme Risiken einzugehen. Wer in einer verzweifelten Lage ist, muss manchmal gefährliche Wege gehen. So wie die Menschen, die derzeit in wackligen Booten den Ärmelkanal überqueren.